Dettare un testo in metropolitana, in aereo o in una sala riunioni con segnale ballerino non è più solo una promessa da keynote. Google ha pubblicato su iOS una nuova app di dettatura AI progettata per funzionare prima di tutto in locale, anche senza connessione stabile. È una mossa silenziosa ma significativa: porta sull’iPhone un’esperienza di riconoscimento vocale pensata per essere rapida, privata e utilizzabile davvero nei contesti in cui il cloud non basta.

Secondo quanto riportato da TechCrunch, Google ha rilasciato l’app su App Store puntando su un’architettura offline-first. Il quadro è coerente con una traiettoria più ampia dell’azienda: negli ultimi anni Google ha investito in modelli speech on-device, sia su Android sia all’interno di Gboard e dei Pixel, per ridurre latenza e dipendenza dalla rete. Anche Apple, da parte sua, ha spostato diverse funzioni di dettatura ed elaborazione vocale sul dispositivo, segno che il terreno competitivo non è più solo l’accuratezza, ma il compromesso tra privacy, velocità e affidabilità reale.

In altre parole, non si tratta soltanto di “un’altra app AI”. È un test concreto su come l’AI generativa e i modelli speech possano diventare utility quotidiane, meno appariscenti e più utili.

Un’app di dettatura che parte dal dispositivo, non dal cloud

Il punto centrale è nel design offline-first. In pratica, l’app è pensata per eseguire la trascrizione vocale direttamente sull’iPhone per i casi d’uso principali, limitando la dipendenza dai server remoti. Questo approccio ha tre effetti immediati.

Il primo è la latenza. Quando l’elaborazione avviene sul dispositivo, il testo appare più rapidamente e in modo più continuo, senza i tempi morti tipici dell’upload audio, dell’elaborazione remota e della restituzione del risultato. Il secondo è la resilienza: l’app resta utilizzabile anche in assenza di rete o con connettività debole. Il terzo è la privacy, almeno per una parte sostanziale del flusso, perché l’audio non deve necessariamente lasciare il telefono per ogni sessione di dettatura.

Questa logica non nasce nel vuoto. Google ha documentato in più occasioni il proprio lavoro sui modelli di speech recognition compatti eseguiti direttamente sui dispositivi. Un riferimento importante è il percorso avviato con il riconoscimento vocale “next generation” di Gboard su Pixel, costruito per combinare accuratezza e inferenza locale con bassa latenza. In parallelo, la documentazione Apple su Dettatura e sul framework Speech conferma che su iPhone una quota crescente dell’elaborazione vocale può avvenire on-device, soprattutto nelle funzioni più recenti e nelle lingue supportate. Il secondo riscontro autorevole, quindi, non è solo la notizia del rilascio: è l’evoluzione tecnologica già visibile nei sistemi mobili che rende plausibile e verificabile questo tipo di esperienza.

Cosa cambia nell’uso quotidiano

La differenza più evidente, per l’utente, è molto pratica. Un’app del genere non punta soltanto a trascrivere note lunghe, ma a sostituire il gesto di digitare in molte situazioni brevi e frequenti: messaggi, appunti veloci, bozze di email, liste, memo vocali convertiti in testo.

Se l’esperienza è stata progettata bene, i vantaggi si vedono in quattro punti:

-

Avvio rapido: apri l’app, tocchi il microfono e inizi a parlare, senza dover aspettare handshake con il cloud.

-

Trascrizione continua: il testo compare mentre parli, con meno interruzioni.

-

Uso in mobilità: funziona in ascensore, in treno, in aereo o all’estero senza roaming affidabile.

-

Maggiore controllo sui dati: non tutto dipende dall’invio costante dell’audio a server esterni.

Detto questo, “offline” non significa automaticamente “completo in ogni funzione”. Qui entra in gioco il limite reale che il caporedattore chiede giustamente di esplicitare: nelle app AI moderne spesso il nucleo base funziona in locale, mentre funzioni più avanzate possono richiedere rete. Per esempio: riassunti automatici, riformulazioni, traduzioni complesse, sincronizzazione tra dispositivi o salvataggio cloud potrebbero non essere disponibili offline o avere un comportamento diverso. Senza documentazione tecnica completa dell’app, la formula più corretta è distinguere tra trascrizione primaria on-device e feature accessorie potenzialmente dipendenti dalla connessione.

I limiti concreti: accuratezza, lingue, autonomia, contesto

Un’app di dettatura offline-first è interessante proprio perché mette in evidenza i compromessi. E i compromessi esistono.

1. Accuratezza variabile in ambienti rumorosi

Il riconoscimento vocale locale può essere molto rapido, ma rumore di fondo, voci sovrapposte e microfoni non ideali restano problemi classici. In auto, in strada o in open space la qualità della trascrizione può calare sensibilmente. Non è un difetto solo di Google: è una condizione tecnica generale del speech-to-text mobile.

2. Supporto linguistico non uniforme

Le prestazioni migliori dei modelli vocali arrivano quasi sempre prima in inglese e nelle lingue più diffuse. Per l’italiano la qualità potrebbe essere buona, ma non necessariamente al livello delle implementazioni più mature. Anche punteggiatura automatica, nomi propri, termini tecnici e code-switching tra lingue restano aree delicate.

3. Consumo di risorse sul dispositivo

Elaborare audio in locale riduce la dipendenza dal cloud ma trasferisce parte del costo computazionale sull’iPhone. Questo può tradursi in maggiore uso di CPU o Neural Engine, con effetti su batteria e temperatura durante sessioni prolungate. Per una nota rapida non è un problema; per dettature lunghe o uso intensivo quotidiano può diventarlo.

4. Meno “intelligenza” contestuale rispetto al cloud

I sistemi cloud hanno accesso a modelli più grandi e a più potenza di calcolo. In locale, per ragioni di spazio ed efficienza, i modelli devono essere più compatti. Risultato: la velocità migliora, ma certe correzioni contestuali, certe inferenze semantiche o certe trasformazioni del testo possono essere meno sofisticate.

Perché Google lo fa adesso

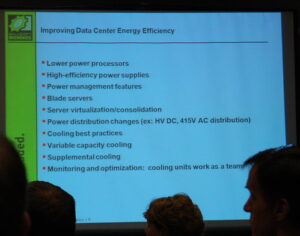

Il tempismo conta. Negli ultimi due anni il mercato mobile si è spostato con decisione verso l’AI on-device. La spinta arriva da più fattori: costi di inferenza nel cloud, attenzione regolatoria alla privacy, aspettative degli utenti su velocità e affidabilità offline, oltre alla crescente potenza dei chip mobili.

Google è in una posizione peculiare. Da un lato domina servizi cloud e AI su larga scala. Dall’altro, ha interesse a dimostrare che i suoi modelli possono vivere bene anche sul dispositivo, inclusa una piattaforma come iOS che non controlla direttamente. Portare su iPhone un’app di dettatura offline-first significa entrare in un territorio dove l’utente giudica l’esperienza in pochi secondi, senza branding tecnico a fare da scudo.

È anche una mossa competitiva. Apple ha già reso la dettatura una funzione nativa molto integrata nell’ecosistema iPhone. Per convincere gli utenti a scaricare un’app separata, Google deve offrire almeno uno tra questi elementi: maggiore precisione, interfaccia più semplice, migliori esportazioni del testo, più lingue, o una gestione più intelligente di appunti e bozze.

Il contesto: non solo dettatura, ma AI utile e meno vistosa

C’è un elemento culturale in questa uscita. Dopo la fase in cui ogni prodotto AI cercava di stupire con chatbot e generazione di contenuti, molte aziende stanno tornando a casi d’uso più sobri ma ad alto valore. La dettatura rientra perfettamente in questa categoria.

Parlare è spesso più rapido che scrivere. Ma per anni il dettato digitale ha oscillato tra due estremi: abbastanza comodo da provarlo, non abbastanza affidabile da usarlo sempre. L’AI on-device prova a colmare proprio questo scarto. Se il testo compare subito, se la privacy è ragionevole, se l’app non smette di funzionare quando manca rete, l’uso può diventare abituale.

Non è una rivoluzione spettacolare. È più sottile. Ed è proprio per questo che merita attenzione: quando l’AI scompare nell’interfaccia e resta soltanto l’utilità, spesso è lì che comincia l’adozione vera.

Cosa aspettarsi nelle prossime versioni

Se il rilascio su iOS sarà accolto bene, è plausibile aspettarsi tre direzioni di sviluppo. La prima è l’espansione del supporto linguistico e il miglioramento della punteggiatura automatica. La seconda è l’integrazione con funzioni editoriali leggere, come pulizia del testo, riformulazione o strutturazione in note e task. La terza è una gestione ibrida più trasparente: base offline, potenziamento cloud opzionale quando disponibile.

Questa architettura “locale quando serve, cloud quando conviene” è sempre più comune. E probabilmente rappresenta il vero equilibrio per molte applicazioni AI consumer: velocità e privacy in prima battuta, capacità extra in seconda battuta.

Il punto, al netto dell’annuncio

La nuova app iOS di Google conta meno per il clamore del lancio e più per ciò che misura. Misura se gli utenti sono pronti a preferire strumenti AI specializzati, veloci e affidabili a funzioni più generiche. Misura quanto valore abbia oggi l’offline reale, non solo dichiarato. E misura anche la maturità dell’AI mobile: non più soltanto assistenti che promettono tutto, ma strumenti che fanno bene una cosa precisa.

Per chi lavora spesso in movimento, detta note o scrive molte bozze da smartphone, è un rilascio da seguire con attenzione. A patto di tenere i piedi per terra: l’elaborazione on-device migliora tempi e privacy, ma non elimina i limiti classici del riconoscimento vocale. La domanda giusta, quindi, non è se questa app sostituirà la tastiera. È se riuscirà a diventare abbastanza affidabile da farcela lasciare in tasca più spesso.

Riscontri utilizzati per il contesto e la verifica: TechCrunch sul rilascio dell’app; documentazione e comunicazioni ufficiali Google sul riconoscimento vocale on-device in Gboard/Pixel; documentazione Apple su dettatura ed elaborazione vocale on-device in iOS.