Alibaba ha pubblicato ieri Qwen3.6-27B, un modello da 27 miliardi di parametri che supera il suo predecessore da 397 miliardi sui benchmark di coding. Non è un refuso: 27 battono 397. E gira su una singola RTX 4090.

Rilasciato il 22 aprile su Hugging Face con licenza Apache 2.0, Qwen3.6-27B è il primo modello dense della famiglia Qwen3.6. Attiva tutti i suoi parametri durante l’inferenza, senza i meccanismi di routing dei modelli Mixture-of-Experts. Questo lo rende più semplice da deployare, più prevedibile nella quantizzazione e compatibile con framework come llama.cpp, SGLang e vLLM. La differenza rispetto a un modello MoE è concreta: niente expert routing da configurare, compressione più lineare, integrazione diretta con gli strumenti che gli sviluppatori usano già.

I numeri

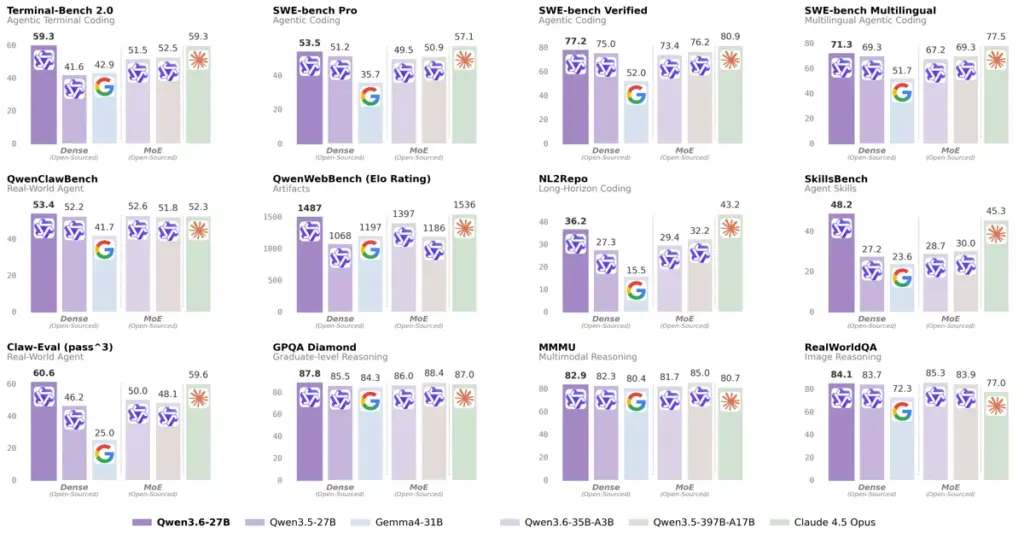

Su SWE-bench Verified, il benchmark de facto per il coding agentivo, Qwen3.6-27B segna 77,2%. Il modello Qwen3.5 da 397 miliardi si ferma al 76,2%. Su SWE-bench Pro il vantaggio è più netto: 53,5% contro 50,9%. Su Terminal-Bench 2.0, che misura l’esecuzione autonoma di comandi in un terminale reale con timeout di 3 ore e risorse limitate, il modello da 27B eguaglia Claude 4.5 Opus con un 59,3%.

Il salto più grande si vede su SkillsBench, dove Qwen3.6-27B passa dal 27,2% della versione precedente al 48,2%. Un miglioramento relativo del 77%. È il tipo di balzo che di solito associ a un modello completamente nuovo, non a un’evoluzione della stessa famiglia con gli stessi parametri. Su reasoning, il modello segna 87,8% su GPQA Diamond e 94,1% su AIME26, entrambi miglioramenti rispetto alla generazione precedente.

C’è un caveat. Questi numeri arrivano dal scaffold agentivo interno di Qwen. Le riproduzioni indipendenti sono ancora limitate, e i test della community sono positivi ma preliminari. Trattali come indicativi finché non avremo verifiche più ampie.

Architettura ibrida

Il segreto è nella nuova architettura. Qwen3.6-27B usa un approccio ibrido chiamato Gated DeltaNet: il 75% dei sublayer usa attention lineare, con complessità O(n) invece di O(n²), e solo il 25% usa la self-attention tradizionale. Il modello elabora la maggior parte del contesto in modo efficiente, riservando l’attention classica ai casi dove serve la massima precisione.

Il pattern si ripete ogni 4 layer: 3 blocchi Gated DeltaNet seguiti da 1 blocco di Gated Attention standard. Una struttura che ricorda ciò che i paper su DeltaNet teorizzavano l’anno scorso, ma che nessuno aveva ancora applicato a un modello di questa scala in produzione.

La finestra di contesto nativa è 262.144 token, estendibile fino a un milione con YaRN scaling. Per chi lavora con codebase grandi significa caricare un intero repository nel contesto senza saturare la memoria.

Thinking Preservation

La feature più interessante si chiama Thinking Preservation. I modelli di reasoning generano una catena di pensiero durante ogni risposta, ma la scartano prima del turno successivo. A ogni messaggio il modello riparte da zero e deve ri-derivare contesto che aveva già elaborato. Sembra inefficiente, e lo è.

Qwen3.6-27B conserva opzionalmente i trace di ragionamento nella storia della conversazione. In un flusso agentivo, dove il modello scrive codice, testa, corregge e riprova, questo significa meno token sprecati, un KV cache più efficiente e decisioni più coerenti tra un passo e l’altro. Si attiva con un singolo parametro: preserve_thinking: True. Per ora è una feature unica tra i modelli open source, e il team di Qwen suggerisce di mantenere almeno 128K token di contesto per ottenerne il massimo.

Cosa cambia nella pratica

Il modello è scaricabile, modificabile e utilizzabile commercialmente senza restrizioni. Con una quantizzazione Q4_K_M occupa circa 16,8 GB: entra in una RTX 4090, in un Mac con 24 GB di memoria unificata, o in qualsiasi sistema con 18 GB tra RAM e VRAM. In full precision BF16 serve una GPU con almeno 60 GB, ma per la maggior parte degli scenari di coding la quantizzazione Q4 è il punto dolce tra qualità e requisiti hardware.

Le reazioni della community su r/LocalLLaMA sono miste ma tendenzialmente positive. Diversi sviluppatori riportano che il modello risolve problemi complessi di coding in uno o due tentativi, con un utente che lo ha usato per riscrivere un’app di budgeting personale che Qwen3.5-27B non riusciva a completare. Altri segnalano problemi con il rispetto delle istruzioni: tende ad agire prima di ricevere il comando completo. Un utente lo ha definito un overtrained slop machine per la tendenza a generare token inutili quando va in loop. La diagnosi più comune attribuisce il problema a CUDA 13.2, che Nvidia sta correggendo.

Un modello che gira su hardware consumer e compete con sistemi 15 volte più grandi non è un esercizio accademico. Cambia le opzioni concrete per sviluppatori e aziende che non vogliono dipendere da API cloud per il coding assistito. Se i benchmark saranno confermati da verifiche indipendenti, Qwen3.6-27B diventa il riferimento nella fascia sotto i 30 miliardi di parametri.