La corsa dell’intelligenza artificiale non sta cambiando solo il software. Sta anche riscrivendo la geografia dell’energia. Dietro ogni chatbot, modello generativo e servizio cloud “sempre acceso” ci sono data center più grandi, più densi e molto più assetati di elettricità. È qui che si apre il tema più rilevante delle ultime ore: il nodo tra AI, infrastrutture digitali e rete energetica, un fronte che coinvolge in modo diretto provider cloud, imprese, utility, regolatori e, alla fine, anche i consumatori.

La notizia non è un singolo annuncio spettacolare, ma un segnale di sistema. Da un lato cresce la domanda di capacità computazionale per l’AI. Dall’altro aumenta l’attenzione politica e regolatoria sui costi e sulla sostenibilità di questa espansione. Il risultato è un cambio di scala: i data center non sono più soltanto una questione industriale o infrastrutturale, ma un tema di politica economica ed energetica.

Perché questa storia conta adesso

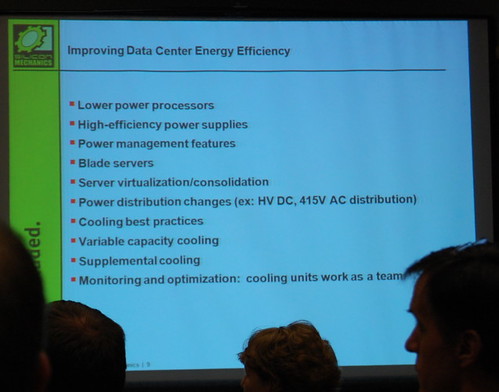

Il punto centrale è semplice: l’AI sta accelerando la domanda di potenza di calcolo, e la potenza di calcolo richiede energia. Molta energia. I data center tradizionali erano già infrastrutture energivore, ma la nuova ondata legata ai modelli generativi e all’inferenza continua dei sistemi AI sta alzando ulteriormente il livello del consumo elettrico e della necessità di raffreddamento.

Questo produce effetti immediati. Per i grandi cloud provider significa investimenti più intensi in impianti, contratti di fornitura e sviluppo di nuovi siti. Per le utility significa dover pianificare reti più robuste, nuovi carichi e una domanda più concentrata in aree geografiche specifiche. Per i regolatori, infine, significa dover rispondere a una domanda delicata: come sostenere l’innovazione senza scaricare i costi sull’intero sistema elettrico?

Il problema non è solo quanto consuma l’AI, ma quando e dove consuma. La concentrazione dei carichi in cluster di data center può mettere sotto pressione reti locali già vicine ai limiti, rendendo più complessa la pianificazione energetica e più costoso ogni nuovo allaccio. In altre parole, l’AI non cresce in astratto: si ancora a cavi, sottostazioni, permessi, tempi di connessione e capacità di generazione.

La lettera dei senatori all’EIA

A rafforzare il tema c’è un segnale politico ravvicinato: la lettera dei senatori all’EIA, l’agenzia statunitense che raccoglie e analizza dati sull’energia. Il messaggio è chiaro: serve più trasparenza e una fotografia più precisa dell’impatto dei data center sulla domanda elettrica. Non è solo una richiesta tecnica. È il sintomo di un cambio di attenzione a livello federale, dove la crescita dell’infrastruttura AI viene ormai osservata come possibile fattore di stress per il sistema energetico.

Questo passaggio è importante perché sposta il dibattito fuori dalla sola narrativa dell’innovazione. Quando i legislatori chiedono all’EIA maggiori informazioni, il tema smette di essere una previsione futuribile e diventa un dossier operativo. Significa che la traiettoria dei data center è entrata nel radar di chi deve gestire stabilità della rete, tariffe, affidabilità e impatti territoriali.

Per il settore tech, questo può voler dire più reporting, più confronto con le autorità e più attenzione alla localizzazione dei nuovi siti. Per il settore energetico, invece, la conseguenza è una pressione crescente a bilanciare domanda industriale, decarbonizzazione e capacità di servizio. Non è un equilibrio facile: la crescita dell’AI promette produttività e nuovi servizi, ma richiede una base fisica molto concreta e spesso lenta da adeguare.

Gli effetti su cloud, utility e imprese

La prima conseguenza si vede nei cloud provider. Le big tech stanno già correndo per assicurarsi capacità di calcolo, ma ora devono farlo con un’ulteriore variabile: l’energia disponibile. Non basta più comprare chip o aumentare il numero di server; bisogna garantire continuità elettrica, efficienza termica e accesso a fonti che rendano sostenibile la crescita nel tempo.

Le utility, dal canto loro, si trovano davanti a clienti molto diversi dal passato: pochi operatori giganteschi, ma con richieste di carico enormi e continue. Questo cambia la logica della pianificazione. La domanda dei data center può diventare un driver di investimenti nella rete, ma anche una fonte di congestione, ritardi autorizzativi e tensioni con altri utilizzatori industriali.

Le imprese non tecnologiche sono coinvolte a loro volta. Più il costo dell’infrastruttura AI sale, più le aziende si domandano quanto valga davvero la promessa di efficienza offerta dai modelli generativi. Se la nuova ondata di servizi AI richiede energia sempre più costosa o difficile da garantire, il conto economico dell’adozione potrebbe cambiare. E questo vale soprattutto per i player che stanno integrando l’AI nei processi interni, nella customer experience e nelle applicazioni cloud mission critical.

In prospettiva, c’è anche una dimensione geografica. Le aree con energia più abbondante, reti più moderne e procedure autorizzative più rapide potrebbero diventare nuove capitali dei data center. Al contrario, i territori con infrastrutture più fragili rischiano di vedere rallentare gli investimenti, o di dover ripensare la propria attrattività industriale.

Cosa può succedere nei prossimi mesi

Il prossimo passaggio sarà capire se la pressione politica si tradurrà in dati migliori, regole più puntuali o nuove richieste alle aziende. La lettera dei senatori all’EIA è un primo segnale, ma potrebbe aprire una fase più ampia di monitoraggio e discussione pubblica. In parallelo, il mercato continuerà a spingere nella direzione opposta: più AI, più calcolo, più infrastruttura.

È qui che si gioca la vera partita. Se il sistema riesce ad assorbire la crescita con investimenti intelligenti, efficienza e pianificazione, l’AI potrà espandersi senza trasformarsi in un collo di bottiglia energetico. Se invece la domanda correrà più veloce della rete, la conseguenza sarà una combinazione di costi più alti, ritardi nei progetti e maggiore scrutinio regolatorio.

Per ora, il messaggio è uno solo: l’AI non è più soltanto una storia di modelli, chip e software. È una storia di infrastrutture fisiche, di energia e di capacità del sistema di reggere una nuova ondata di domanda. Ed è proprio questo incrocio tra data center, intelligenza artificiale e rete elettrica a renderlo il fronte più interessante da seguire oggi.

In sintesi: la crescita dell’AI sta accelerando la domanda di data center e quindi di energia. La lettera dei senatori all’EIA mostra che il tema è ormai diventato una questione di policy, non solo di mercato. Per cloud provider, utility e imprese, la variabile energia sarà sempre più decisiva nelle scelte di investimento e di adozione dell’AI.