C’è fermento nel campo dell’intelligenza artificiale, specialmente quando si tratta di affrontare sfide complesse come le dimostrazioni matematiche. Dal laboratorio cinese DeepSeek arriva una notizia interessante per chi segue il mondo dell’AI applicata alla matematica: è stato aggiornato il loro modello Prover, specificamente pensato per risolvere dimostrazioni e teoremi.

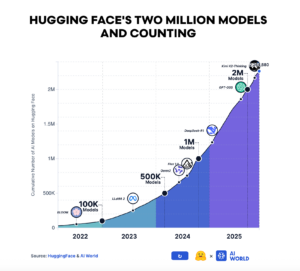

Questa nuova versione, la V2, è apparsa quasi in punta di piedi sulla piattaforma per sviluppatori AI Hugging Face, insieme a una sua variante “distillata”. Secondo quanto riportato dal South China Morning Post, sembra che questa V2 affondi le sue radici nel modello V3 della startup, un modello imponente con ben 671 miliardi di parametri. Adotta un’architettura MoE (mixture-of-experts), un approccio che spezza i compiti complessi in sotto-parti gestite da “esperti” più piccoli e mirati.

Pensiamo ai parametri come agli ingranaggi che determinano la capacità del modello di risolvere problemi; più sono, più potenziale c’è. E la struttura MoE è un po’ come avere una squadra di specialisti, ognuno bravissimo nel suo campo, che lavorano insieme su un problema per trovare la soluzione più efficiente.

Non è la prima volta che Prover si rinnova: l’ultima volta è successo ad agosto, quando era stato presentato come un modello AI personalizzato e open source, pensato proprio per il rigore delle dimostrazioni formali e il ragionamento matematico.

Questo aggiornamento si inserisce in un periodo piuttosto dinamico per DeepSeek. Già a febbraio, Reuters aveva riportato che l’azienda stesse valutando di raccogliere finanziamenti esterni per la prima volta. Di recente hanno rilasciato una versione potenziata del loro modello generico V3, e sembra che presto toccherà anche al modello R1, quello dedicato specificamente al “ragionamento”, confermando il loro impegno nello spingere i confini dell’AI.