La NSA sta usando Mythos Preview, il modello di Anthropic considerato troppo pericoloso per il pubblico, per scansionare infrastrutture e cercare vulnerabilità. Lo ha rivelato Axios citando due fonti interne. La notizia arriva settimane dopo che il Dipartimento della Difesa, ovvero l’agenzia madre della NSA, ha etichettato Anthropic come “supply chain risk”, il marchio che il Pentagono riserva ai fornitori considerati una minaccia per la sicurezza nazionale.

Perché il Pentagono ha messo Anthropic nella blacklist? Perché Anthropic ha rifiutato di rendere Claude disponibile per la sorveglianza di massa e lo sviluppo di armi autonome. Anthropic ha fatto causa al Dipartimento della Difesa a marzo. E intanto la NSA, che dal Dipartimento della Difesa dipende, ha trovato il modo di usare lo stesso modello che il suo ente parente considera troppo rischioso.

La contraddizione è talmente evidente che basterebbe da sola come commento.

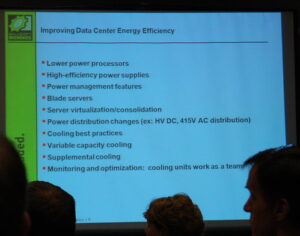

Mythos Preview è un modello di cybersecurity che Anthropic ha deliberatamente tenuto fuori dal mercato. L’accesso è limitato a circa 40 organizzazioni nel mondo, di cui solo una dozzina è stata nominata pubblicamente. Tra queste c’è l’AI Security Institute del Regno Unito. La NSA non figurava nell’elenco. Ci è arrivata comunque.

Il modello ha dimostrato la capacità di trovare migliaia di vulnerabilità zero-day, incluse alcune vecchie di decenni. Ingegneri senza formazione specifica in sicurezza hanno ottenuto exploit funzionanti in una notte. È esattamente il tipo di strumento che un’agenzia di intelligence vorrebbe avere, e che un attaccante statale vorrebbe rubare.

La storia si complica con un altro dettaglio. Venerdì 17 aprile, il CEO di Anthropic Dario Amodei si è incontrato alla Casa Bianca con la capo di gabinetto Susie Wiles e il segretario al Tesoro Scott Bessent. La Casa Bianca ha definito l’incontro “produttivo”. Un segnale che il rapporto tra Anthropic e l’amministrazione Trump potrebbe sbloccarsi, dopo mesi di tensione.

Intanto, la NSA continua a usare Mythos. Il Pentagono continua a sostenere in tribunale che Anthropic è un rischio per la sicurezza nazionale. E Anthropic continua a distribuire il suo modello più pericoloso a un pugno di entità selezionate, tra cui l’agenzia che il suo stessa governo sta cercando di tenerne lontana.

La domanda non è se l’AI trasformerà la sicurezza nazionale. La domanda è chi decide le regole, e perché quelle regole non sembrano applicarsi a chi le scrive.