Le immagini generate dall’intelligenza artificiale hanno sempre avuto un difetto imbarazzante: non sapevano scrivere. Letteralmente. Chiedi a un modello di disegnare un cartello stradale e ottieni geroglifici indecifrabili. Chiedi una locandina per un concerto e il titolo diventa un collage di lettere casuali. OpenAI ha appena presentato ChatGPT Images 2.0, e quel problema sembra finito per sempre.

Il nuovo modello, battezzato gpt-image-2, è disponibile da ieri per tutti gli utenti ChatGPT, Codex e via API. Non è solo un upgrade qualitativo: è un salto di categoria. Per la prima volta, un modello di generazione immagini integra le capacità di reasoning della serie O di OpenAI. Prima di disegnare, il modello pensa.

Cosa significa concretamente? Che Images 2.0 può cercare sul web per verificare i fatti, analizzare documenti caricati dall’utente, pianificare la composizione visiva e persino autocorreggersi prima di consegnare il risultato. Sam Altman ha definito il salto dal modello precedente “equivalente al passaggio da GPT-3 a GPT-4”. Esagerazione? Forse. Ma i risultati sono sotto gli occhi di tutti.

Il testo che funziona, in ogni lingua

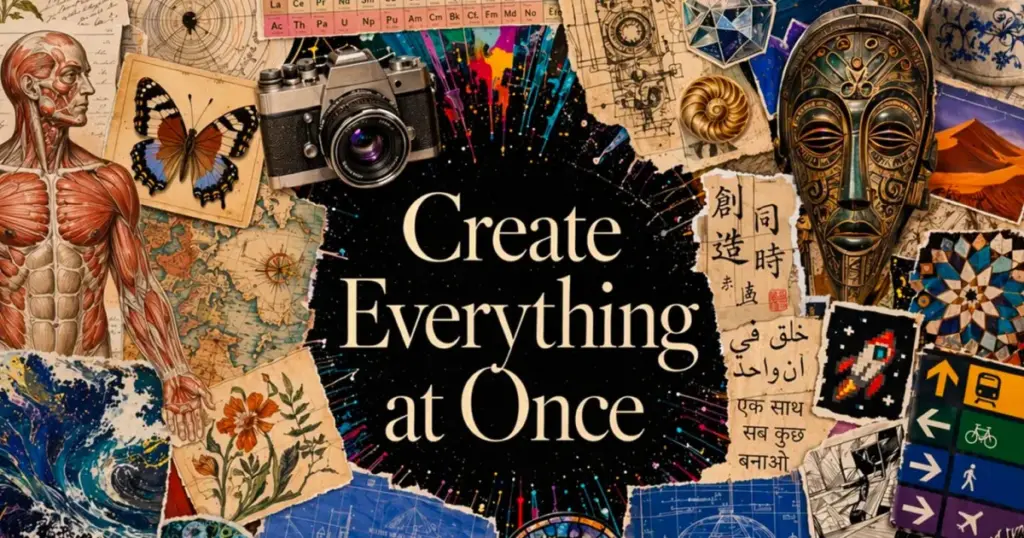

La conquista più evidente è il rendering del testo. Il nuovo modello produce tipografia professionale all’interno delle immagini: titoli nitidi, allineamenti precisi, codici a barre leggibili su finti numeri di rivista. Funziona con il latino, ma soprattutto con caratteri non latini: giapponese, coreano, cinese, hindi, bengalese. Non si tratta di traduzione appiccicata su un’immagine, ma di testo integrato nel design, con un flusso che sembra nativo. Puoi chiedere a ChatGPT di creare un’infografica completa con dati, grafici, etichette e didascalie, e otterrai qualcosa di pronto per la pubblicazione. Slide, mockup di interfacce, mappe geografiche con legende leggibili: roba che dodici mesi fa avrebbe richiesto ore di lavoro su Canva o Figma, adesso esce in pochi minuti da un prompt.

Modalità Thinking e generazione multi-immagine

La vera differenza sta in due modalità operative. La Modalità Istantanea è veloce, per bozze rapide e grafiche semplici. La Modalità Thinking è più lenta ma ragiona sul risultato: consulta il web, analizza il contesto, verifica la coerenza visiva. Ed è qui che succede la magia multi-immagine: da un singolo prompt puoi ottenere fino a 8 immagini coerenti tra loro, con continuità di personaggi e oggetti da un frame all’altro.

Sono possibili storyboard, fumetti, campagne multi-formato, libri illustrati per bambini. Il modello mantiene la coerenza dei volti e degli stili attraverso le immagini, qualcosa che fino a ieri era un miraggio. Sul fronte tecnico, la risoluzione arriva a 2K via API (con 4K in beta), e i formati coprono proporzioni da 3:1 a 1:3: banner orizzontali, schermate mobile, poster verticali.

Dwayne Koh, creative strategist di Canva, ha provato il modello in anteprima e lo descrive così: non stava solo “renderizzando immagini, ma interpretando brief, comprendendo audience, prendendo decisioni creative dietro le quinte”. Images 2.0 non è un pennello più fine: è un art director con cui collaborare.

I limiti e il contesto competitivo

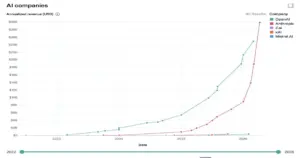

Non è tutto perfetto. Il modello fatica ancora con il ragionamento fisico preciso: guide all’origami, cubi di Rubik, oggetti visti da angolazioni complesse. Il knowledge cutoff è dicembre 2025, quindi non sa nulla di eventi successivi. E le iterazioni hanno rendimenti decrescenti: dopo un paio di round di modifica, conviene resettare il contesto in una chat nuova, un trucco suggerito da Ethan Mollick della Wharton School. Sul fronte competitivo, Google ha il suo Gemini 3.1 Pro Image (conosciuto come Nano Banana 2), che fino alla settimana scorsa guidava la classifica dell’LM Arena per la generazione immagini. OpenAI lo supera adesso nella riproduzione di interfacce utente, nella generazione multi-immagine e nella coerenza visiva. Anthropic, dal canto suo, ha lanciato Claude Design la stessa settimana, posizionandosi come rivale diretto di Figma e Canva.

Il segnale strategico è chiaro: DALL-E 2 e DALL-E 3 verranno ritirati il 12 maggio. OpenAI sta consolidando tutto sotto il marchio Images, trattando la generazione visiva non più come feature accessoria ma come livello base dell’interazione con l’AI. “Le immagini come linguaggio, non come decorazione” è la frase che apre il comunicato ufficiale, ed è la sintesi migliore di quello che sta succedendo.

Per gli sviluppatori, il modello gpt-image-2 è accessibile via API con prezzi a consumo: 8 dollari al milione di token per l’input immagine, 30 per l’output, due dollari in meno rispetto al modello precedente. Una riduzione che conta, per chi lavora con volumi alti di generazione visiva.