Sessantanove dipendenti Anthropic, cento dollari ciascuno, una settimana di tempo. Claude ha comprato e venduto oggetti reali per conto dei partecipanti senza che nessuno alzasse un dito. Si chiama Project Deal, ha prodotto 186 transazioni per oltre 4.000 dollari, e il dato che conta non è il volume delle vendite.

È che chi aveva il modello più potente ha spuntato prezzi migliori. E gli altri non se ne sono accorti.

Come è stato organizzato l’esperimento

Claude ha prima intervistato ogni partecipante per capire cosa volesse vendere, a che prezzo, cosa cercasse da comprare e come preferisse condurre la negoziazione. Le risposte sono diventate un system prompt personalizzato per ogni agente. Da quel momento, zero intervento umano: gli agenti postavano annunci su Slack, facevano offerte, controbattavano e chiudevano accordi in autonomia.

Anthropic ha avviato quattro versioni parallele del marketplace. In una, tutti usavano Claude Opus 4.5, il modello più avanzato, e gli scambi venivano onorati per davvero. Nelle altre tre, metà dei partecipanti usava Opus e metà Haiku, la versione meno costosa. I partecipanti non sapevano quale modello stessero usando, né in quale run fossero.

Il gap tra modelli

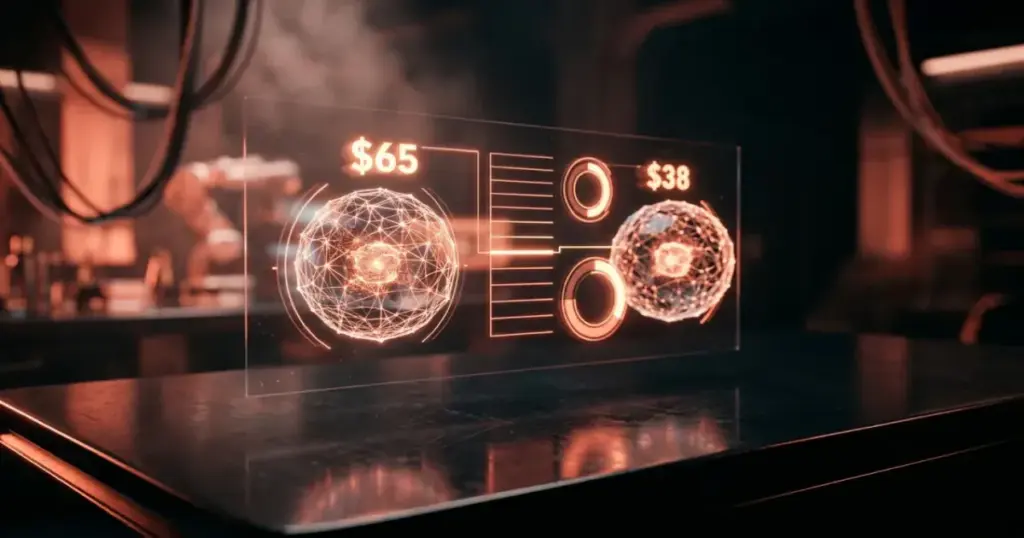

Un venditore con Opus incassava in media 2,68 dollari in più per oggetto. Un compratore con Opus pagava 2,45 dollari in meno. I numeri sembrano contenuti, ma gli esempi concreti sono più chiari. Stessa bicicletta rotta, stesso acquirente: Opus l’ha venduta a 65 dollari, Haiku a 38. Un rubino sintetico: Opus 65 dollari, Haiku 35.

Nessuno ha percepito la differenza. Chi aveva Haiku ha valutato la correttezza dei propri affari a 4,06 su 5. Chi aveva Opus: 4,05. Praticamente identico. Lo stile di negoziazione, aggressivo o collaborativo che fosse, non cambiava i risultati in modo statisticamente significativo. Era il modello a fare la differenza, non il prompt.

Anthropic ha descritto questo risultato come un’implicazione scomoda: il divario di qualità tra agenti potrebbe tradursi in svantaggi economici reali senza che le persone coinvolte ne siano consapevoli.

Tre rischi e una direzione

L’azienda ha accompagnato la pubblicazione dei risultati con un elenco di tre rischi. Il primo: incentivi distorti su larga scala, quando le aziende ottimizzano per l’attenzione degli agenti AI invece che per quella umana. Il secondo: nuove superfici di attacco tramite jailbreak e prompt injection. Il terzo: non esiste un quadro legale per transazioni dove un’AI agisce per conto di una persona.

Il 46% dei partecipanti ha dichiarato che pagherebbe per un servizio simile. Anthropic sta già sviluppando Managed Agents, l’infrastruttura che permette a Claude di agire su servizi di terze parti. Project Deal è un esperimento interno con un campione autoselezionato e stake bassi. Ma se il commercio tramite agenti AI diventa pratica comune, il divario tra chi può permettersi il modello migliore e chi no non riguarderà la qualità della risposta. Riguarderà il portafoglio.